Хартли формула не отразява статистически произволната природа на събитията, така че като цяло е необходимо да се осигури връзка между количеството на информацията, както и вероятността от настъпване на съответните събития (съобщения).

Този проблем е решен през 1946 г., американският математик Клод Шанън.

В подхода на статистическа (вероятност), информация се счита като мярка за вероятността от възникване на съответното съобщение.

От тази гледна точка, събитието е по-вероятно, по-малък е размерът на информация в доклада за него имаме.

Много видове съобщения могат да бъдат сведени до двойно събитие.

Като цяло, събитието може да се счита за резултатите от резултатите от някои експеримент. Пълният група на всички възможни резултати от тези ситуации разрешително, наречено ансамбъл от събития.

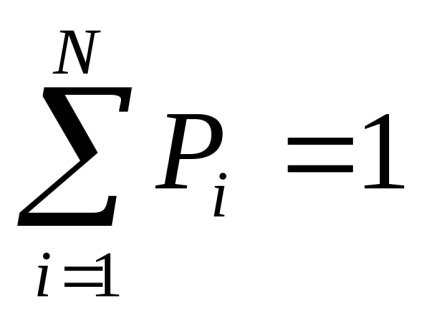

Нека от общия брой на всички възможни изходи е равен на N, от които K не се повтаря.

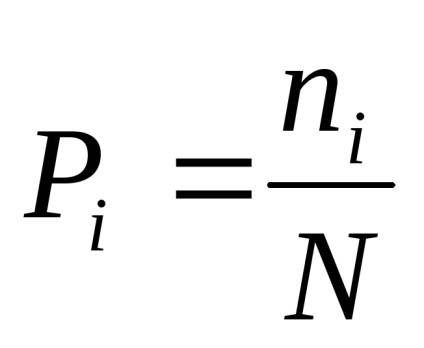

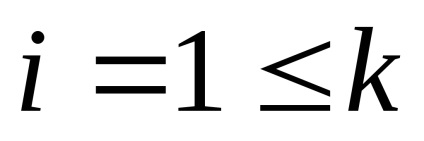

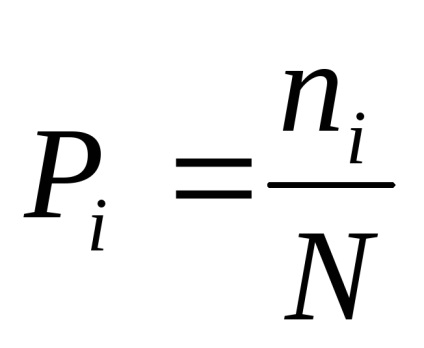

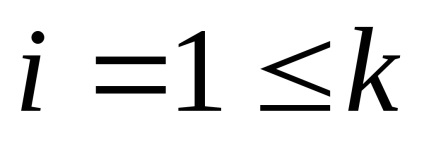

Тогава вероятността-тото събитие.

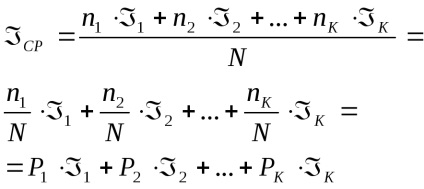

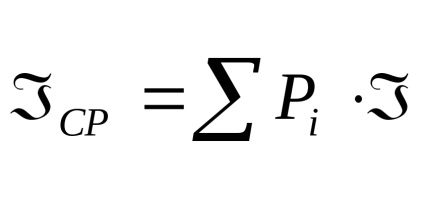

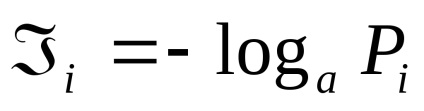

Всеки изпълнение на това събитие носи определено количество информация

4 Статично информация мярка. Вероятност и информация

Хартли формула не отразява статистически произволната природа на събитията, така че като цяло е необходимо да се осигури връзка между количеството на информацията, както и вероятността от настъпване на съответните събития (съобщения).

Този проблем е решен през 1946 г., американският математик Клод Шанън.

В подхода на статистическа (вероятност), информация се счита като мярка за вероятността от възникване на съответното съобщение.

От тази гледна точка, събитието е по-вероятно, по-малък е размерът на информация в доклада за него имаме.

Много видове съобщения могат да бъдат сведени до двойно събитие.

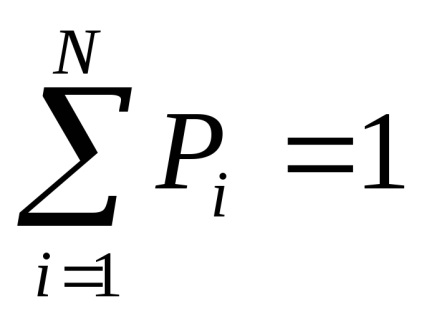

Като цяло, събитието може да се счита за резултатите от резултатите от някои експеримент. Пълният група на всички възможни резултати от тези ситуации разрешително, наречено ансамбъл от събития.

Нека от общия брой на всички възможни изходи е равен на N, от които K не се повтаря.

Тогава вероятността-тото събитие.

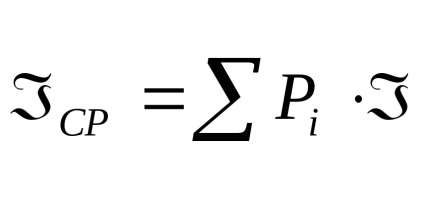

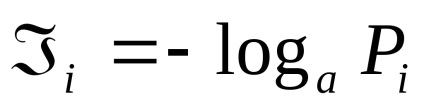

Всеки изпълнение на това събитие носи определено количество информация

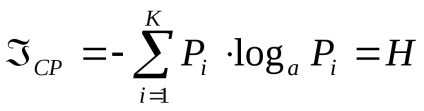

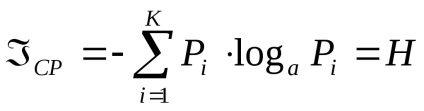

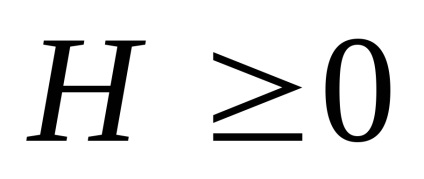

свойства на ентропията

1. ентропията се измерва в същите единици като количеството информация.

Знакът "-" във формулата (2) означава, че ентропията не винаги е отрицателен, т.е.

2. ентропията на M достига максимум, когато всички събития са еднакво вероятни.

3. N = 0, ако вероятността от един от събития I-те години е 1.

По този начин, ентропия е мярка за несигурност в поведението на източника на съобщението и характеризира способността на източника да предоставят информация.

С увеличаването на броя на възможните състояния на системата за енергийни увеличава.

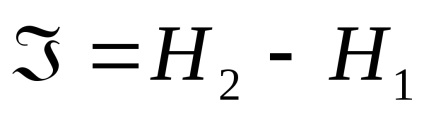

Като цяло, може да се предположи, че сумата на информация представлява намаляване на ентропията в резултат на процеса на обучение.

Ако несигурността отпада напълно, количеството енергия, равна на сумата на информация, издадена от източника.

В случай на непълна резолюция на ситуацията, количеството на информацията се определя от разликата между началната и крайната стойност на ентропията:

т.е. на информация ще се определя от разликата между началните и крайните стойности на ентропията.

Най-голямо количество информация се получава, когато несигурността отпада напълно.

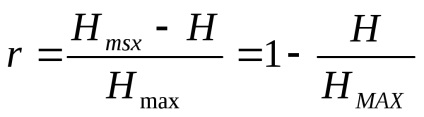

Реални събития и герои в реални взаимоотношения не са взаимно независими и еднакво вероятни, че наистина носи всеки индивидуален характер, да бъде по-малка от максималната теоретично възможна стойност.

характеризиращ се с количество на загуба на информация коефициент съкращения:

За информация се използва канал за предаване характеристика, наречена скоростта на предаване на информацията за канала, това е средната сума на информация, която може да се предава по канала за връзка в даден момент.

Средната сума на предоставената информация от източника на съобщения за единица време се нарича източник на производителността.

Максималната скорост на предаване на информация канал, наречен капацитета на канала.

Проблемът на съвпадение източници на продуктивност и ефективност на канала за предаване, е един от най-важните проблеми на теорията и практиката на кодиране на информация.

Свързани статии